O que dizem as características das câmeras dos smartphones e você pode confiar nelas?

Miscelânea / / May 14, 2021

Lifehacker explica como descobrir dezenas de megapixels e diferentes distâncias focais.

No início do desenvolvimento dos smartphones, uma categoria separada se destacou - o telefone com câmera: nesses aparelhos, a atenção máxima era dada à câmera. Agora, todo modelo carro-chefe de quase todas as marcas está tentando atrair a atenção com a implementação de câmera mais complexa e interessante. As características dos dispositivos são mascaradas por palavras altas, slogans ousados, números enormes e seus próprios nomes de tecnologias. Mas é possível subtrair algo útil deles e entender se esta câmera é capaz de produzir uma imagem decente? Vamos descobrir agora.

Principais recursos das câmeras de smartphones

As características de uma câmera de smartphone são essencialmente as mesmas de qualquer câmera digital. Mas você precisa entender pelo que este ou aquele parâmetro é responsável.

Megapixels

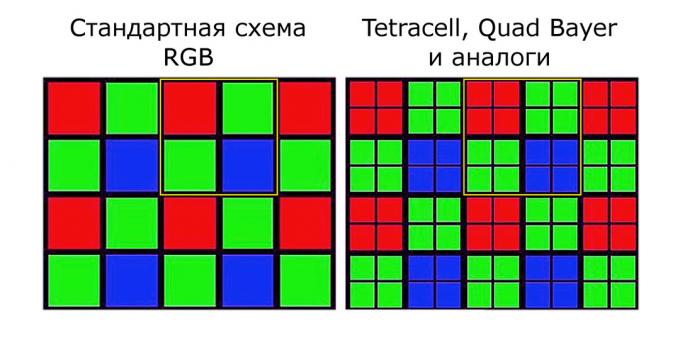

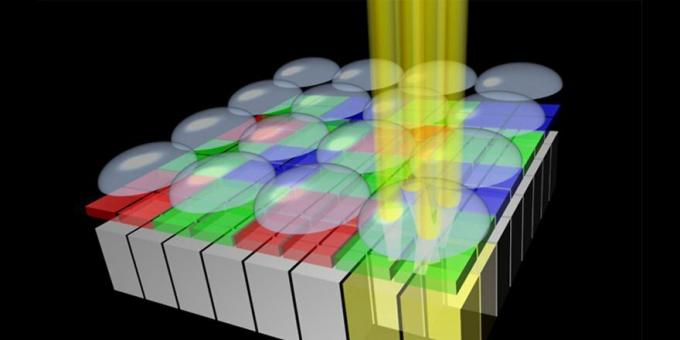

Os fabricantes prestam mais atenção a eles em campanhas publicitárias. Um pixel é um elemento sensível à luz em um sensor de câmera, ou fotodiodo. É composto por quatro subpixels, cada um dos quais, devido aos filtros de luz, permite que apenas a luz de sua própria sombra passe. Na maioria das vezes, são vermelhos, azuis e verdes. A partir da combinação dessas cores, obtém-se um ponto de tonalidade e brilho desejados.

Alguns fabricantes estão abandonando o esquema mais popular e adicionando branco ou amarelo aos filtros de cor vermelha, azul e verde. Nesse caso, o fotodiodo captura mais luz e as imagens são mais brilhantes.

Os megapixels mostram em que resolução a câmera é capaz de tirar fotos, ou seja, em quantos milhões de pixels a imagem final será composta.

Hoje, muitos fabricantes apresentam smartphones com câmeras de 48, 64 ou 108 megapixels que operam no modo de fusão de pontos. Em tais sensores, os pixels não consistem em quatro, mas em 16 subpixels, combinados por quatro. Se em um sensor clássico, por exemplo, um pixel consiste em um azul, dois verdes e um vermelho subpixel, em câmeras de alta resolução consiste em quatro azuis, oito verdes e quatro vermelhas subpixels.

Ao aumentar o número de pixels, a sensibilidade à luz aumenta e o intervalo dinâmico da imagem aumenta - a diferença entre as áreas mais claras e mais escuras da foto. Mas, ao mesmo tempo, câmeras de 48 megapixels, devido a tal combinação, de fato criam imagens com resolução de 12 megapixels. E não há nada de errado aqui: é o caso em que quantidade se transforma em qualidade, e fotos com resolução de 4.000 × 3.000 (esses mesmos 12 megapixels) bastam para publicação nas redes sociais.

Tamanho do sensor

Este é talvez o elemento mais importante de uma câmera de smartphone. O tamanho do sensor indica a área sobre a qual os diodos sensíveis à luz estão localizados. Quanto maior o sensor, maiores podem ser os próprios pixels, e quanto maior o pixel, melhor ele capta a luz. Os tamanhos de pixel típicos em sensores de câmeras móveis modernos são de 0,8 a 2,4 mícrons; no entanto, o último é obtido precisamente pela combinação de subpixels, sobre os quais falamos no parágrafo anterior.

Quanto mais luz o sensor pode capturar, melhores serão as imagens capturadas pela câmera. Isso é especialmente importante ao fotografar em condições de pouca luz. E em tal situação, pode acontecer que um sensor com um número menor de pixels maiores produza uma imagem melhor do que sensor com um número maior de pixels menores, porque cada fotodiodo captava mais luz e, consequentemente, mais em formação.

Ou seja, uma câmera com menos pixels em suas especificações pode superar uma câmera com um grande número de pixels devido ao fato de os próprios pixels serem maiores.

Nos smartphones modernos, as dimensões dos sensores são indicadas em partes fracionárias de uma polegada. O maior sensor, um Samsung ISOCELL GN2 de 50 megapixels, está instalado em Xiaomi Mi 11 Ultra: Mede 1 / 1,12 "na diagonal.

Lentes

As lentes usadas têm um impacto significativo na qualidade da imagem. Eles consistem em lentes - placas transparentes com certas propriedades ópticas. A principal função de uma lente é distorcer corretamente o feixe de luz incidente. O tipo de distorção depende do formato da placa.

Na maioria das vezes, as lentes são compostas por várias lentes, pois uma não é o suficiente. Lentes curvas e côncavas de densidades diferentes se alternam. A seleção e o posicionamento corretos na lente afetarão a clareza e o contraste da imagem. Com lentes curvas, pode ocorrer distorção óptica. Em algumas lentes, como lentes grande-angulares, a distorção, ao contrário, tornou-se uma característica estilística. É verdade que alguns dispositivos os corrigem programaticamente no estágio de pós-processamento.

Nos smartphones modernos, os módulos da câmera consistem em várias lentes, cada uma com seu próprio sensor, adequado para uma tarefa específica. Na maioria das vezes, são lentes padrão, grande angular e macro. Ao mesmo tempo, não se pode dizer que smartphones com várias lentes disparam obviamente melhor do que com uma: depende da implementação de um determinado dispositivo. Pode acontecer que entre as muitas câmeras em um módulo, nenhuma dê um resultado aceitável e a quantidade não se transforme em qualidade.

Comprimento focal e abertura

Quanto menor a distância focal, maior o ângulo de visão da lente e vice-versa - lentes com uma distância focal alta disparam longe, mas ao mesmo tempo com um pequeno ângulo de visão.

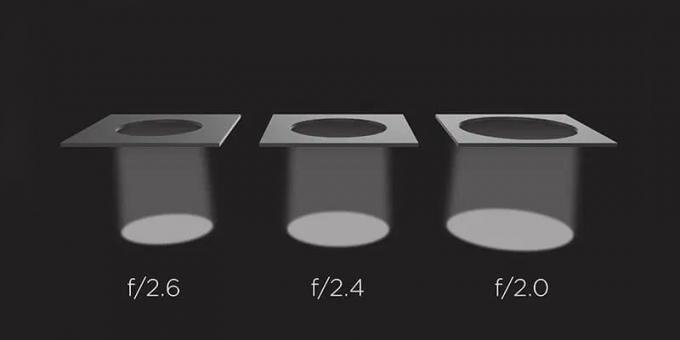

A abertura mostra a quantidade de luz que atinge o sensor da câmera através da lente. A maioria dos smartphones tem uma abertura fixa, que é a relação entre o comprimento focal e o tamanho da entrada da câmera.

Quanto mais luz atingir o sensor e quanto maior for a entrada da câmera, menor será a profundidade de campo, ou seja, apenas o assunto estará em foco e o fundo atrás dele ficará desfocado.

Para aumentar a profundidade de campo, você precisa reduzir a entrada, no entanto, isso também diminuirá o brilho. Em smartphones, isso é mais frequentemente alcançado de forma programática. No entanto, os dispositivos modernos usam módulos com várias lentes - com lentes de diferentes tamanhos, diferentes distâncias focais e aberturas. Portanto, em vez de depender do processamento de software, você pode alternar entre as lentes.

Os smartphones de hoje são equipados com sistemas avançados de foco automático. Por exemplo, na tecnologia PDAF, alguns dos pontos no sensor da câmera são usados como pontos focais. Dois pixels adjacentes estão localizados de modo que um deles perceba o fluxo de luz vindo de cima, e o outro está na parte inferior, e o sistema ajusta o foco no caso de uma quantidade diferente de pixels cair sobre os pixels Sveta.

Há também laser e foco automático baseado em contraste. Algumas empresas usam tecnologias em câmeras que permitem focar em objetos específicos no quadro, por exemplo, reconhecer rostos e torná-los mais nítidos.

Ampliação

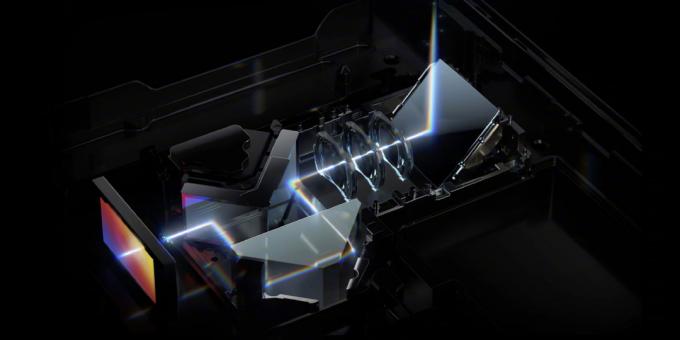

O zoom mostra o quão perto a imagem pode estar. Existem duas opções de zoom: digital e óptico. O digital simplesmente amplia e corta a imagem em tamanho real. A lente ótica usa lentes especiais para ampliação que, devido ao sistema de lentes correto, podem parecer distantes.

Com o desenvolvimento de câmeras em smartphones, cada vez mais módulos com zoom óptico começaram a aparecer - geralmente 2X ou 3X. No entanto, também existem opções que os fabricantes chamam de periscópios. Essas lentes utilizam um sistema de lentes e espelhos localizados lateralmente no corpo do smartphone e, devido a eles, é possível obter, por exemplo, um zoom quíntuplo. O quão perto você pode chegar de uma imagem depende da distância focal.

O zoom óptico máximo que os smartphones oferecem hoje é 10x. Ocorre em Huawei P40 Pro + (é nele que o mesmo "periscópio" é usado) e em lentes individuais do Samsung Galaxy S21 Ultra. Para os casos em que um zoom tão forte não é necessário, esses smartphones também têm lentes com uma ampliação menor - 3x.

Sensores auxiliares

Sensores de luz, sensores de profundidade, telêmetros, lidars - todos esses sistemas ajudam o smartphone a entender onde os objetos que estão sendo fotografados estão localizados, como estão iluminados, se movendo ou não. O smartphone utiliza os dados obtidos tanto no visor quanto no processo de pós-processamento, completando e editando a imagem.

A resolução dos sensores está longe de ser o parâmetro mais importante: um número muito pequeno de pixels é suficiente para que eles executem bem suas funções. Portanto, você não deve se surpreender ao ver, por exemplo, um sensor de profundidade com resolução de 2 megapixels: são suficientes para seu funcionamento.

Resolução de vídeo e taxa de quadros

A resolução do vídeo indica quantos pixels estarão contidos em um quadro. E a taxa de quadros é quantos desses quadros por segundo serão obtidos.

À medida que os pixels crescem, os detalhes e a clareza da imagem melhoram. Conforme a taxa de quadros aumenta, o efeito de desfoque diminui, o vídeo parece mais nítido e melhor percebido pelo olho humano. Além do mais, os vídeos capturados em altas taxas de quadros podem ser desacelerados para os familiares 24fps para um efeito de câmera lenta interessante.

HDR

HDR significa High Dynamic Range, que é uma grande diferença entre as partes mais claras e mais escuras de uma imagem. A câmera no modo HDR tira várias fotos (no caso de filmagem de vídeo - quadros) com diferentes exposições e depois as combina, equilibrando as áreas claras e escuras. Devido a isso, é possível obter um maior contraste e detalhes de imagem.

Magia de pós-processamento

As características secas das câmeras dos smartphones são, obviamente, confusas e assustadoras. E o problema mais importante é que não é realista entender apenas a partir desses números como a câmera do smartphone vai filmar.

Além da lente e do próprio sistema de sensor, há também um chicote do processador de imagem ao redor da câmera. e software de pós-processamento - algoritmos que analisam os dados recebidos e usam vários sistemas proprietários uluchshayzery. Como resultado, as empresas que usam os mesmos sensores podem acabar com imagens completamente diferentes devido aos diferentes sistemas de pós-processamento.

Cada fabricante tem uma abordagem diferente para a renderização de cores e análise dos limites dos objetos. Cada empresa usa uma variedade de truques e tecnologias para conseguir uma imagem que corresponda ao seu senso de beleza. Algumas marcas usam o aprendizado de máquina para identificar corretamente os objetos no quadro e como eles deveriam se parecer, e tudo isso também faz parte do processamento.

Vamos dar um exemplo simples entre smartphones bastante populares. Realme 7 Pro e Samsung Galaxy M51 as câmeras principais são construídas nos mesmos sensores - Sony IMX682. É um sensor de 64 megapixels alimentado por sistema de agregação de subpixel Quad Bayer e produz imagens com uma resolução de 16 megapixels (mas também capaz de funcionar em modo de tamanho real). Apesar de possuírem os mesmos sensores, as próprias imagens são completamente diferentes.

A reprodução de cores da Samsung à luz do dia é mais suculenta e vibrante, embora sem supersaturação excessiva. As fotos do Realme 7 Pro receberam uma gama um pouco mais suave e realista, mas às vezes os limites dos pequenos detalhes se perdem nelas, por exemplo, lâminas individuais de grama, filmadas relativamente longe. Na Samsung, o sistema de pós-processamento e redução de ruído define os limites com mais clareza, o que, no entanto, às vezes cria uma sensação de artificialidade. Confundir as fotos tiradas com esses telefones não funcionará, apesar dos mesmos sensores.

Como o pós-processamento de imagens funciona em um telefone específico não pode ser entendido a partir das características. Somente análises profissionais com fotos de teste tiradas em vários modos ajudarão aqui.

Sem fé em megapixels

As especificações não garantem uma boa imagem. Não se pode argumentar que uma câmera de 108 megapixels vai fotografar melhor do que uma de 64 megapixels, porque além dos megapixels, outros parâmetros da câmera também afetam o resultado.

O primeiro passo é prestar atenção ao tamanho do sensor: quanto maior, mais luz recebe, e a qualidade da imagem depende diretamente da quantidade de luz. O próximo em importância é a parte de hardware do sistema de pós-processamento de imagem e, em seguida, o software. O modo como funcionam pode ser entendido apenas ao ver as fotos tiradas por um telefone com este sistema.

A única opção é confiar nas análises, que publicam fotos de teste em diferentes condições de disparo: sob diferentes condições de iluminação, em movimento, a diferentes distâncias, e assim por diante. E não se esqueça que as principais ferramentas do fotógrafo e do operador são os braços esticados e a capacidade de capturar o momento. E o resto é secundário.

Leia também🧐

- Como tirar uma boa foto: 6 princípios básicos

- Qual smartphone comprar em 2021

- De 0,11 megapixels a assistentes de redes neurais: como as câmeras evoluíram nos smartphones